从AI宠物到开源中枢:Hugging Face的意外崛起逻辑

Hugging Face 并非一开始就要做“AI 的 GitHub”。从一次展会上的偶遇、一个无聊的 AI 助手想法,到押注开源 Transformer,这家公司走出了一条高度非线性的路径。本文还原 Clem Delangue 的真实叙述,讲清 Hugging Face 为什么能成为开源 AI 的核心基础设施。

Hugging Face 并非一开始就要做“AI 的 GitHub”。从一次展会上的偶遇、一个无聊的 AI 助手想法,到押注开源 Transformer,这家公司走出了一条高度非线性的路径。本文还原 Clem Delangue 的真实叙述,讲清 Hugging Face 为什么能成为开源 AI 的核心基础设施。

如果你还以为 AI 只是“回答问题”,那你已经落后了。AutoGPT 出现不到一周,就有人让它自己找商机、装开发环境、写代码、跑业务,甚至把待办清单“执行掉”。这不是 Demo,这是一场关于 AI Agent 的提前预演。

Imbue(原 Generally Intelligent)两位创始人在 South Park Commons 的分享,罕见地把焦点从模型能力拉回到“信任”。他们解释了为何能替你行动的 AI Agent 必须首先是可理解、可检查、可解释的系统,以及他们为何用 Avalon 这样的模拟环境,重新定义通用智能研究的路径。

在这期Lex Fridman播客中,Instagram联合创始人Kevin Systrom回顾了从产品早期设计到被Facebook收购后的关键抉择。他分享了如何通过用户行为而非数据迷信来理解“人们真正喜欢什么”,以及产品一致性、技术取舍和组织文化对一家公司的长期影响。

Lex Fridman 在解读 Tesla AI Day 时认为,这场发布会的震撼不在于单点技术突破,而在于首次完整展示了解决自动驾驶与通用机器人问题所需的“规模化工程全景”。从向量空间感知、多摄像头时序融合,到数据标注闭环与 Dojo 计算平台,Tesla 展示了一条难以复制的真实世界智能路线。

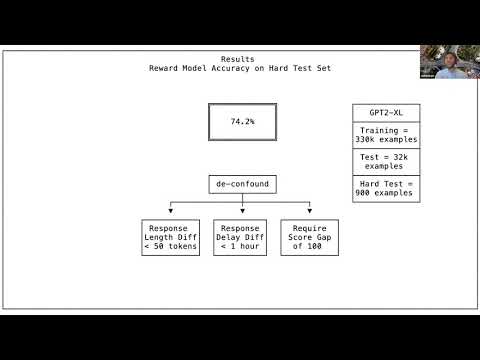

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

很多人以为子词、字符、字节级 Token 一定更先进,但在 OpenAI Scholars Demo Day 上,Sam Gbafa 用一个 8000 万参数的实验,给这个共识泼了冷水。结果不但反直觉,还直接影响你今天怎么选 tokenizer、怎么配上下文窗口。

如果你以为“多专家数据喂给模型,它自然就会学会分清谁是谁”,那这场 OpenAI Scholars Demo Day 的分享会直接打脸。Tyna Eloundou 用一个看似优雅、实则极具野心的框架,展示了:我们不仅能让模型学到多种行为,还能在需要时精准切换它们。

在这期Lex Fridman播客中,强化学习奠基者之一Michael Littman回顾了从TD-Gammon到AlphaGo的关键转折,讨论了强化学习与Transformer浪潮的关系,并对通用人工智能的现实形态提出了冷静而反直觉的判断。

这是一场看似轻松的“编程梗图评审”,却意外暴露了George Hotz对编程、机器学习、测试工程和互联网产品的深刻理解。通过吐槽、段子和真实经历,他展示了一套极度工程师化、反直觉但高效的技术世界观。