最安静的AI猎手:苹果收购21家AI公司,把谷歌微软都甩在身后

当所有人盯着OpenAI、谷歌和微软在台前“秀肌肉”时,苹果在水面下做了一件更狠的事:6年收购21家AI公司,数量超过谷歌和微软之和。这不是八卦,而是一个正在重塑AI竞争逻辑的信号。

当所有人盯着OpenAI、谷歌和微软在台前“秀肌肉”时,苹果在水面下做了一件更狠的事:6年收购21家AI公司,数量超过谷歌和微软之和。这不是八卦,而是一个正在重塑AI竞争逻辑的信号。

当所有人还在争论AI训练到底侵不侵权时,Getty和Adobe已经换了一个打法:不等法律落地,先把“商业可用”这件事做成。这期《The AI Daily Brief》揭示的,不只是工具更新,而是生成式AI即将分化成两条完全不同的路线。

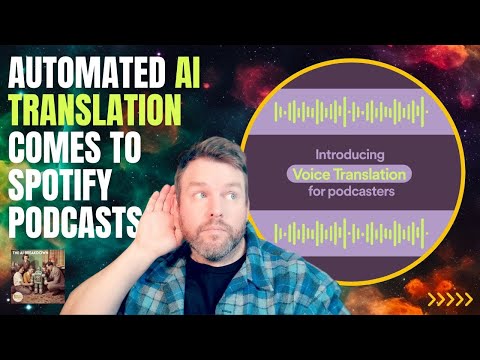

Spotify宣布用AI把播客“原声翻译”成多国语言,这不只是一个新功能,而是一记重拳:它直接打在了一整批AI语音创业公司的命门上。更残酷的是,几天前YouTube已经做过一次类似的事。这篇文章讲清楚:这场战争,真正的赢家和输家分别是谁。

如果你还以为“AI焦虑”只存在于推特和学术圈,这组最新民调会让你清醒:多数美国人已经不相信AI的好处能盖过风险。但更值得关注的不是恐惧本身,而是——谁在害怕,谁在加速,以及这对AI从业者意味着什么。

一夜之间,亚马逊砸出最高40亿美元,牵手Claude背后的Anthropic。这不只是投资,而是一场对标“微软+OpenAI”的全面结盟。从模型安全、AI芯片到云平台,AI战争的底层规则正在被重写。

ChatGPT 能看图、能听你说话、还能直接开口回应了。这不是一次普通功能更新,而是一次使用范式的断裂式变化。更关键的是,它发生在 Google Gemini 即将登场、AGI 传言四起的时间点。

Greg Isenberg 抛出一个反直觉结论:在 AI 和 No-code 时代,最危险的创业方式反而是只做一个项目。他提出“Multipreneurship”——一年做多个产品,用社区、AI 和小团队滚出一个商业帝国。这不是鸡汤,而是一套可复制的方法论。

当所有人都盯着ChatGPT和Copilot时,亚马逊在秋季硬件发布会上做了一件更激进的事:让Alexa彻底重生。从“指令机器”变成真正会理解你家的AI,这一步,可能比你想的更危险,也更值钱。

如果你还以为 AI 只是帮你写文案、画图,那这场 YouTube 的发布会会让你彻底改观。从选题、剪辑、配乐到自动配音,Google 正在把“做视频”这件事本身,变成一个 AI 驱动的流水线。

这不是一次普通的产品发布,而是一次范式转移。微软正在把 Copilot 推进 Windows 的每一个角落,试图让“对话”成为操作系统的新入口。当 AI 不再是 App,而是 OS 本身,整个 AI 创业与应用生态,可能都要被重写。