AI开始“看见”你的想法:从脑波生成视频,已经不是科幻了

如果我告诉你:AI已经能在你什么都不说的情况下,把你“看到的画面”复原成视频,你会觉得这是噱头还是失控的前夜?这项名为 Mind Video 的研究,正在把“读心术”从科幻拖进现实,而且速度比大多数人想象得更快。

如果我告诉你:AI已经能在你什么都不说的情况下,把你“看到的画面”复原成视频,你会觉得这是噱头还是失控的前夜?这项名为 Mind Video 的研究,正在把“读心术”从科幻拖进现实,而且速度比大多数人想象得更快。

如果你还以为 Photoshop 的 AI 只是“更聪明的修图”,那你已经落后了。这支视频里,Adobe 用 Generative Fill 展示了一个更激进的未来:不是修图更快,而是“想法直接变成像素”。更重要的是,它正在悄悄改变创作者的工作边界。

一边是Meta高调宣布自研AI芯片和超级算力,一边是Apple悄悄封禁ChatGPT、同时被曝在内部憋大招,而纽约公立学校却反向操作,重新拥抱生成式AI。这不是零散新闻,而是一场正在成型的“AI基础设施战争”。

不是AutoGPT,也不是新模型,而是一个看似低调的插件,让整个AI圈再次沸腾。ChatGPT的Code Interpreter在上线几天内,就被用来写论文、做商业战略、剪视频、生成GIF,甚至重新定义了“数据分析”这件事。

当所有人盯着 Runway、Google、NVIDIA 时,一个被低估的名字正在创作者圈子里疯狂出圈。Kaiber 不只是“又一个 AI 视频工具”,它暴露了一个更残酷的事实:真正能改变创作门槛的,往往不是最会发论文的公司。

设计系统最大的敌人不是规范不够,而是人类自己。一次 Config 演讲里,一位产品设计师展示了一个反直觉的原型:用 TensorFlow 给 Figma 做“拼写检查”,自动揪出设计系统里的隐形错误。这不是概念,而是已经跑起来的插件。

UX设计长期奉为圭臬的“以用户为中心”,正在暴露出时代局限。设计师Patricia Reiners结合XR、AI与平台经济的实践经验,提出应从“用户优先”转向“社会优先”,否则短期成功可能换来长期代价。

Lex Fridman 通过 Pixel 6 的一次“AI 开箱”,讲清了智能手机竞争正在从参数堆叠,转向以 AI 芯片为核心的体系之争。这不仅是一次硬件评测,更是一份关于边缘 AI、异构计算与未来人机关系的思考。

Lex Fridman 在解读 Tesla AI Day 时认为,这场发布会的震撼不在于单点技术突破,而在于首次完整展示了解决自动驾驶与通用机器人问题所需的“规模化工程全景”。从向量空间感知、多摄像头时序融合,到数据标注闭环与 Dojo 计算平台,Tesla 展示了一条难以复制的真实世界智能路线。

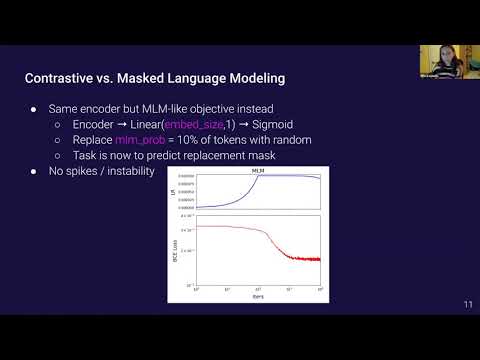

在计算机视觉里横扫榜单的对比学习,一搬到自然语言却问题频出。OpenAI Scholars Demo Day 上,Ellie Kitanidis 公开了一次并不“完美”的尝试:用对比学习预训练语言模型。真正的猛料不在结果,而在她暴露出的那个几乎所有语言模型都会撞上的隐形难题。