他用Reddit训练AI审美,结果发现人类偏好有74%的天花板

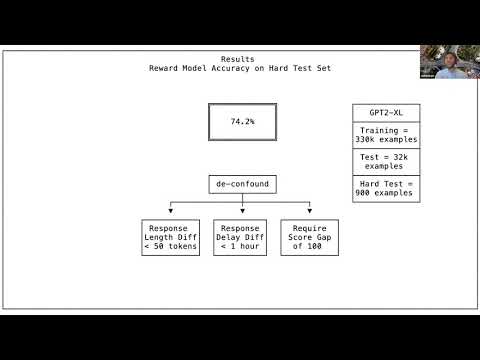

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

OpenAI 学者 Jonathan Ward 做了一件反直觉的事:不用人工标注、不请外包标注员,而是直接拿互联网的“点赞”来训练奖励模型。结果很震撼——模型学会了人类偏好,但准确率卡在了 74%。这背后,藏着今天所有 RLHF 系统的真相与瓶颈。

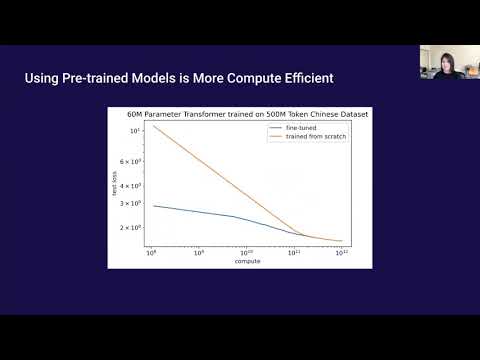

很多人直觉认为:只要模型够大、预训练够久,语言迁移自然水到渠成。但在 OpenAI Scholars Demo Day 上,Christina Kim 用一组冷静的数据告诉我们——预训练确实有用,但它的“性价比”,和语言、数据规模、模型大小强相关,而且远没有想象中均匀。

在 OpenAI Scholars Demo Day 上,Christine Payne 做了一件反直觉的事:她没有发明全新的音乐模型,而是把“生成音乐”硬生生改造成一个语言模型问题。结果令人震惊——很多人已经分不清 AI 和人类作曲。但真正的挑战,才刚刚开始。

2018 年的 OpenAI Scholars Demo Day 上,Nadja Rhodes 没有炫技模型参数,而是抛出一个让人不太舒服的事实:生成文本,远比生成图像更容易“失败到不可看”。她的项目 Deephypebot,不只是一个音乐评论机器人,而是一场关于“如何让语言模型不再胡说八道”的实验。

在这段与Lex Fridman的对话中,fast.ai创始人Jeremy Howard给出了与主流路径截然不同的深度学习学习建议:不要停留在看论文或跑推理,而是亲手训练、微调大量模型,并且始终围绕你真正关心的真实问题。

Pinterest搜索团队分享了他们将大语言模型引入搜索排序的完整实践:从相关性建模、内容标注,到用知识蒸馏解决规模与成本问题。这是一套已经在线服务数十亿搜索请求的真实系统,而不是实验室原型。

这是一场由 ComfyUI 原作者 ComfyAnonymous 亲自讲述的完整工作坊。从个人项目的诞生,到被数百万创作者和大厂采用,再到节点式工作流为何能承载生成式 AI 的未来,这场演讲给出了许多只有一线开发者才能说出的真实判断。

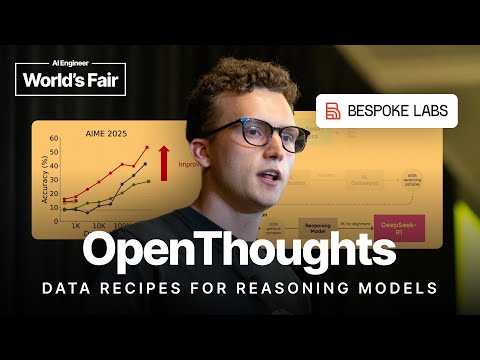

在这场演讲中,Bespoke Labs 创始工程师 Ryan Marten 复盘了 OpenThoughts 项目的完整探索过程:为什么 DeepSeek R1 的成功让他们意识到“数据配方”才是推理模型的关键,以及他们如何通过系统化实验,把监督微调(SFT)的推理能力推到新的高度。

这是一场典型“工程师视角”的AI工作坊。Daniel Han不追逐概念热词,而是从开源模型的真实演进出发,串起微调、人类反馈强化学习(RHF)、经典强化学习,再落到量化等工程取舍,帮助听众理解:今天的大模型能力,究竟是如何一步步被“驯化”出来的。

CloudChef联合创始人Nikhil Abraham分享了一个反直觉的结论:机器人做饭最大的难题不是硬件,而是软件。通过机器人基础模型、微调、强化学习与“菜谱状态机”,他们让通用机器人在真实厨房中接近专业厨师水准。