Yann LeCun 罕见开炮:AI 安全恐慌,正在被大厂用来“收编”整个行业

就在全球政府高调讨论 AI 安全之际,Meta 首席科学家 Yann LeCun 公开指控:部分顶级 AI 实验室正在夸大“人类灭绝级风险”,为的不是安全,而是掌控行业规则。这不是学术分歧,而是一场关于开源、监管与未来话语权的正面冲突。

就在全球政府高调讨论 AI 安全之际,Meta 首席科学家 Yann LeCun 公开指控:部分顶级 AI 实验室正在夸大“人类灭绝级风险”,为的不是安全,而是掌控行业规则。这不是学术分歧,而是一场关于开源、监管与未来话语权的正面冲突。

当苹果在发布会上两次说出“AI”这个词,整个行业都愣了一下。不是因为参数有多炸,而是因为这家公司过去十年几乎刻意回避AI叙事。这一次,M3 Max不只是新芯片,而是苹果对AI战争的首次正面回应。

这是美国迄今最重磅的一次AI监管出手,却意外制造了两个对立阵营的同时不满:一边担心创新被扼杀,一边认为监管还不够狠。更反直觉的是,它可能正在“暗中扶持”开源模型。

一家年收入只有300万美元的AI搜索公司,7个月内估值从1.5亿美元跳到5亿美元;另一边,OpenAI的顶级客户却在悄悄“降级”模型、逃离高昂成本。这期AI Daily Brief,把AI应用、模型战争和安全治理的真实张力,全都摊在了台面上。

白宫即将发布的AI行政令,被很多人误解为“又一轮监管收紧”。但真正值得AI从业者警惕的,不是限制模型发布,而是美国政府第一次系统性地用“联邦采购+安全评估”来重塑AI生态。这一步,可能比任何法律都更狠。

很多人注意到,ChatGPT的知识截止时间悄悄推进到了2023年中后期。但如果你只盯着这一点,就会错过真正的大戏:生成式AI正在重塑广告生意,而芯片与算力的博弈,已经变成地缘政治的一部分。

一组疑似泄露的 Google Gemini 截图,暴露的可能不只是一个新模型,而是 Google 正在悄悄改变开发者战争的打法:多模态只是表面,真正的筹码是“谁的工具链能留下开发者”。这件事,值得每个 AI 从业者认真看完。

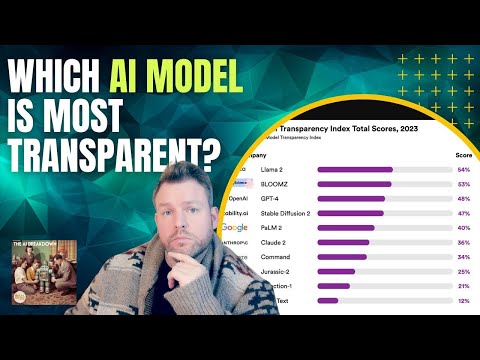

如果你以为最强的AI一定最透明,这份斯坦福最新榜单会直接打脸。研究者用100个指标给主流大模型打分,结果显示:Meta 的 Llama 2 拿下第一,但也只及格一半;而整个行业,在“黑箱”这件事上几乎是集体失分。

Sam Altman 亲口否认 GPT‑4.5 和 GPT‑5,但开发者反而更紧张了。因为真正的猛料,可能不是模型升级,而是 OpenAI 正在悄悄把自己,从“最强聊天机器人”,变成“AI Agent 平台的制定者”。这一步,可能会重塑整个 AI 创业版图。

美国正在酝酿一件比“卡脖子芯片”更激进的事:限制中国获取最先进的AI基础模型。这个变化不只关乎中美博弈,而是可能直接决定你未来能用到什么模型、开源是否还能存在,以及AI创业的门槛会被抬到多高。