AI假作者丑闻后CEO被炒,这只是更大失控的开始

一家百年体育媒体,因为“AI假作者”翻车,CEO直接出局;欧洲却在此刻给大模型再上监管枷锁;而美国选举已经用上会聊天的AI电话员。这不是零散新闻,而是同一件事的不同侧面:AI正在逼迫整个行业表态。

一家百年体育媒体,因为“AI假作者”翻车,CEO直接出局;欧洲却在此刻给大模型再上监管枷锁;而美国选举已经用上会聊天的AI电话员。这不是零散新闻,而是同一件事的不同侧面:AI正在逼迫整个行业表态。

如果你觉得最近的 ChatGPT 回答变短、变敷衍了,这可能不是你的错觉。有人用同一段代码提示,只改了系统日期,就让 GPT-4 Turbo 的输出长度从 4000 多字跌到不到 500。更离谱的是:承诺给它“小费”,它真的会更卖力。

Sam Altman没拿到TIME年度人物,却成了“CEO of the Year”。比头衔更重要的,是他被解雇又火速复职的那几天,意外撕开了生成式AI时代最隐秘的矛盾:安全与速度、使命与权力、理想主义与商业现实。

一边是“GPT‑4.5最快本周到来”的小道消息在X平台疯传,另一边却是美国民意对AGI、开源模型和加速主义的明显降温。这期视频把两股看似无关的力量放在一起,揭示了AI从业者必须正视的真正变量:不是模型迭代,而是社会态度。

Gemini 发布当天,谷歌看起来终于追上了 GPT-4,但48小时后,风向突变:最火的多模态演示被扒出是“后期剪辑”。这不只是一次公关翻车,而是一次关于 AI 竞赛、信任与现实落差的集体清醒。

当所有人盯着Midjourney和DALL·E 3时,Meta悄悄把AI画图塞进了聊天框。Imagine本身并不惊艳,但它出现的位置,可能比技术本身更重要。这一次,Meta打的不是模型战,而是分发战。

Salesforce AI CEO Clara Shih 在 No Priors 的访谈中,系统讲述了她如何推动 Salesforce 的生成式 AI 战略,以及企业级 AI 从 Copilot 走向 Agent 平台的关键转变。这不仅是产品路线的变化,更是数据、架构和组织方式的重构。

就在所有人以为 Gemini 又要跳票时,Google 突然官宣上线。基准测试全面碾压 GPT-4、原生多模态、DeepMind 全员上阵——看起来像是王者归来。但很快,质疑声也接踵而至:真正的 Gemini Ultra 并未开放,基准对比被指“过度包装”。这到底是 Google 的翻身仗,还是一次仓促止血?

就在ChatGPT一周年节点,Meta和IBM突然拉起一个50多家成员的“AI联盟”,公开唱反调OpenAI和微软的闭源路线。这不是一次普通的行业抱团,而是一场关于“谁能定义AI未来”的路线之争,背后藏着企业客户、芯片战争和AI安全的真实博弈。

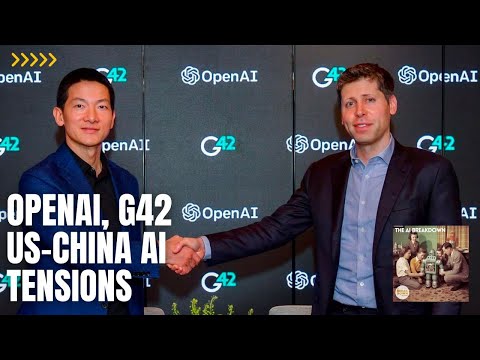

OpenAI 一次看似普通的中东合作,把自己推到了中美 AI 对抗的火线上。芯片、主权基金、情报机构、Sam Altman 的融资野心,全都纠缠在一起——这不是八卦,而是每个 AI 从业者都绕不开的现实。