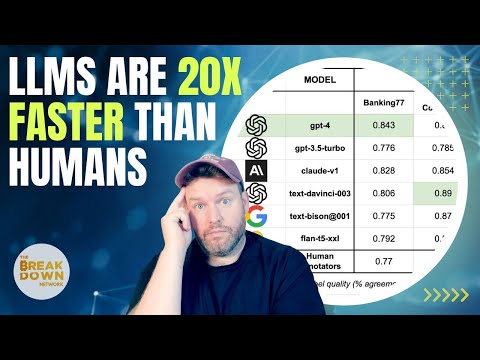

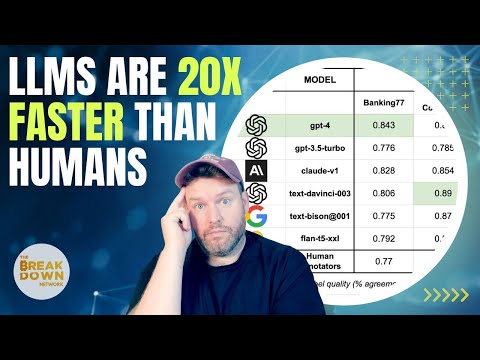

LLM比人类快20倍:数据标注、程序员与创作者同时被改写的一周

一项新研究给出了一个残酷但清晰的数字:大语言模型在数据标注上,比人类快20倍、便宜7倍,而且还更准。这不是单点突破,而是一连串信号——从程序员到音乐人,从欧盟立法者到广告公司,所有人都在同一周感受到了AI的“真实冲击波”。

一项新研究给出了一个残酷但清晰的数字:大语言模型在数据标注上,比人类快20倍、便宜7倍,而且还更准。这不是单点突破,而是一连串信号——从程序员到音乐人,从欧盟立法者到广告公司,所有人都在同一周感受到了AI的“真实冲击波”。

当 Marc Andreessen 高调宣称“AI 将拯救世界”时,硅谷几乎集体鼓掌。但在 The AI Daily Brief 解读的一篇博客中,Dwarkesh 做了一件少见的事:逐条拆解这篇乐观宣言,指出真正让人不安的,不是 AI 不够强,而是我们可能根本控制不了它。

当所有人都在问“AI会不会毁灭人类”,这支视频却抛出一个更激进的判断:AI可能是人类文明有史以来最好的发明。更反直觉的是,真正的风险并不在技术本身,而在我们如何使用、限制甚至恐惧它。

不是科幻小说,也不是推特玩笑。耶鲁一场CEO闭门调查显示,42%的顶级公司掌门人认为AI可能在5到10年内终结人类。但这条爆炸性数据背后,真正值得AI从业者警惕的,并不是“灭绝论”本身。

字节跳动一年买走的英伟达GPU,超过整个中国去年总量;而在华盛顿,AI已经被直接等同为国家安全。真正值得警惕的,可能既不是芯片,也不是模型参数,而是我们正在用什么叙事理解这场AI竞赛。

如果我告诉你,生成式 AI 可能每年给全球经济增加 4.4 万亿美元,你可能会觉得夸张。但麦肯锡真正让人后背发凉的,不是这个数字,而是它对“工作本身”的判断:我们每天做的事,有 60%–70% 都可以被 AI 接管。

如果欧盟的AI法案今天就生效,ChatGPT理论上可能“立刻违法”。不是因为它生成胡话,而是因为它说不清自己训练时用了哪些版权内容。这并不是危言耸听,而是EU刚刚通过的AI Act草案里,最具杀伤力、也最具争议的一条。

如果你还觉得AI只是“写文案、画图”,那你已经落后了。这期视频里,AI不仅在一天内帮人做出了完整RPG游戏,还第一次站上了教会讲坛;与此同时,OpenAI、Meta、NVIDIA、欧盟和英国政府正把AI推向一个更激烈的新阶段。

Salesforce一口气把生成式AI基金加码到5亿美元,还推出了AI Cloud。表面看是产品发布,实则是一场关于“企业该不该信任AI”的豪赌。这不是又一个ChatGPT故事,而是AI真正走进公司核心数据的临界点。

一个不起眼的 Reddit 截图,可能预告了 ChatGPT 的下一次进化:它不只会聊天,还会“长期记住你”。几乎同一时间,微软、谷歌在搜索与多模态上全面提速,而监管者已经开始入场。这不是功能更新合集,而是一场正在加速的 AI 权力重分配。