为什么说 Tesla AI Day 展示了通往真实智能的唯一路径

Lex Fridman 在解读 Tesla AI Day 时认为,这场发布会的震撼不在于单点技术突破,而在于首次完整展示了解决自动驾驶与通用机器人问题所需的“规模化工程全景”。从向量空间感知、多摄像头时序融合,到数据标注闭环与 Dojo 计算平台,Tesla 展示了一条难以复制的真实世界智能路线。

Lex Fridman 在解读 Tesla AI Day 时认为,这场发布会的震撼不在于单点技术突破,而在于首次完整展示了解决自动驾驶与通用机器人问题所需的“规模化工程全景”。从向量空间感知、多摄像头时序融合,到数据标注闭环与 Dojo 计算平台,Tesla 展示了一条难以复制的真实世界智能路线。

这是一场来自 YC Gaming Tech Talks 的真实创业分享:Spellbrush 如何用 GAN 把角色设计从“昂贵且难以扩展”的人力密集型工作,变成可规模化的 AI 流程。文章不仅解释技术原理,还揭示了数据偏差、算力成本和艺术创作边界这些更少被谈及的关键问题。

AGI这个如今被反复讨论的词,并非一次宏大的理论发明,而是一次略带妥协的命名选择。Ben Goertzel回顾了AGI一词的诞生过程,从一本书的标题争论,到DeepMind创始人、AIXI理论和对“智能”本身的怀疑,揭示了AGI背后被忽略的历史与思想张力。

Lex Fridman通过“苦涩教训”回顾了70年AI发展史,指出真正推动指数级进步的不是聪明算法,而是能持续放大算力的通用方法。视频从历史案例出发,讨论了算力、算法、数据与未来计算范式之间的张力。

这段访谈记录了Alexa早期语音技术负责人Rohit Prasad讲述的一段关键历史:一支只有6人的团队,如何在几乎不被看好的情况下,依靠远场语音识别、深度学习和大规模数据,把“对着空气说话”从科幻变成真实产品。

Jeremy Howard结合自己多年教学与研究经历,回顾了从Theano、TensorFlow到PyTorch与fast.ai的技术演进。他直言框架设计如何直接影响研究效率、新手学习曲线,以及整个生态的未来,并对Swift for TensorFlow给出了冷静而独特的判断。

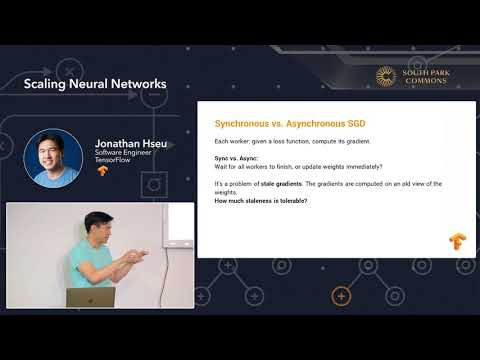

这是一场来自 South Park Commons 的技术分享,Jonathan Hseu 系统讲述了神经网络规模化背后的真实挑战:为什么规模如此重要、工程基础设施如何支撑,以及在模型设计和训练阶段必须做出的关键取舍。文章还原了一线实践中的方法论,而不只是抽象结论。

这场由Dave Patterson等人参与的AI硬件圆桌,回顾了摩尔定律失效后的关键转折点,深入讨论了模型训练与推理的本质差异、GPU与专用芯片的演化路径,以及Google等公司在真实工程约束下做出的取舍。

在这期Lex Fridman播客中,fast.ai创始人Jeremy Howard回顾了自己从早期编程语言到深度学习教育与研究的完整路径。他分享了对编程未来、深度学习实践误区、GPU训练、学习率技巧以及fast.ai诞生背景的独特看法,揭示了为何“把复杂技术交还给更多人”才是真正的突破。

这是一段关于TensorFlow如何从Google内部的实验性工具,演变为全球机器学习基础设施的真实历史。Rajat Monga回顾了Google Brain早期的关键决策、开源背后的犹豫与勇气,以及TensorFlow 2.0为何必须“推倒重来”。