AI重塑教育:机遇、挑战与未来的深度探索

随着大语言模型如Claude和ChatGPT的广泛应用,AI正深刻改变教育的内容、方式与角色分工。本文梳理了Anthropic团队关于AI在教育领域的实践、思考与前瞻,揭示了AI如何赋能个性化学习、促进批判性思维,同时也带来伦理、数据隐私等新挑战。通过多维视角,帮助读者理解AI教育变革的本质与未来方向。

随着大语言模型如Claude和ChatGPT的广泛应用,AI正深刻改变教育的内容、方式与角色分工。本文梳理了Anthropic团队关于AI在教育领域的实践、思考与前瞻,揭示了AI如何赋能个性化学习、促进批判性思维,同时也带来伦理、数据隐私等新挑战。通过多维视角,帮助读者理解AI教育变革的本质与未来方向。

OpenAI 悄悄上线了 ChatGPT Image 1.5。Greg Isenberg 原本只是随手测试,结果一路从“我很怀疑”变成“这可能直接改变我做生意的方式”。更关键的是:这一次,赢的不是模型参数,而是“会不会用”。

如果你还以为Figma的AI只是“帮你生成几张图”,那这支Config视频会让你彻底改观:从抠图、扩图到自动布局,设计中最耗时间、最没成就感的部分,正在被系统级AI接管。

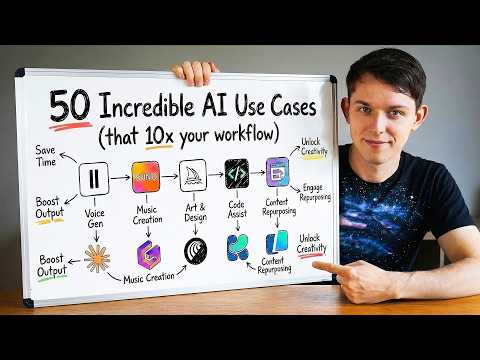

这不是一支教你“怎么用AI”的视频,而是一次赤裸裸的效率碾压。Riley Brown 用50个真实用法证明:AI已经不是工具,而是可以被“配置”的工作伙伴。更反直觉的是,真正拉开差距的,不是模型强弱,而是你会不会用。

很多人以为 Claude Code、Opus 4.5 的上限取决于模型版本,但 Greg Isenberg 给了一个反直觉答案:真正拉开差距的不是模型,而是你和它“合作”的方式。这套来自 Anthropic 使用者圈层的 10 条规则,正在悄悄把普通用户和高手分开。

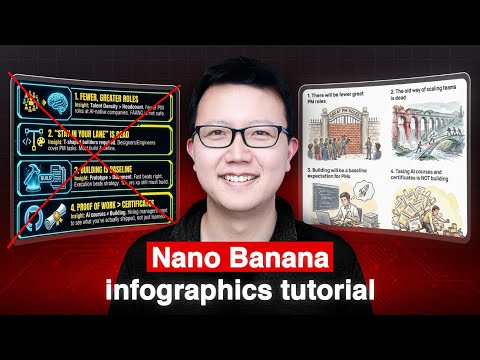

多数人用AI做信息图,得到的却是“AI味”十足的视觉垃圾。Peter Yang在这支教程里给出了一套可复用的方法:不是换模型,而是换思路。通过风格指南、两阶段提示和持续迭代,他用Gemini的Nano Banana Pro在15分钟内稳定产出与品牌高度一致的信息图。

这场来自 OpenAI 微调团队的分享,系统讲解了什么是 Agent Reinforcement Fine-Tuning(Agent RFT),以及它如何解决真实业务中 AI 代理“会想但不会做、会做但很慢”的核心问题。通过多个一线客户案例,演讲者展示了 Agent RFT 在工具调用、延迟控制和少样本学习上的独特价值。

在这场面向早期设计师的 Figma 圆桌里,几位一线从业者几乎达成了一个反直觉共识:真正成熟的 AI 设计能力,不是“会用很多 AI”,而是清楚知道什么时候不用。关于 AI 搜索、语音 AI、Agent 和提示工程,他们讲的不是工具清单,而是一套正在行业内部形成的新判断标准。

过去十年,设计工具一直在进化,但有个尴尬现实始终没变:原型永远只是原型。Figma Make 的出现,第一次把“一句话”直接变成可交互、可上线、背后还有真实代码的应用。这不只是效率提升,而是设计、工程和 AI 协作方式的一次重写。

这期对谈中,Xinran Ma并没有再重复“AI能多快写代码”,而是反思了VIP coding(用大模型直接生成产品原型)在真实设计流程中的盲区。视频围绕五个具体“gap”,讲清楚为什么很多AI原型看起来快,却难以迭代、难以复用、也难以真正走向产品化。