2025年消费级AI格局盘点:巨头竞逐与创新浪潮

2025年,消费级AI领域迎来爆发式创新与激烈竞争。OpenAI、Google等巨头持续引领大模型和多模态产品迭代,创业公司则在垂直场景和用户体验上不断突破。本文梳理年度关键进展,剖析主流产品、用户行为与未来趋势,助你洞悉AI消费化的深层逻辑。

2025年,消费级AI领域迎来爆发式创新与激烈竞争。OpenAI、Google等巨头持续引领大模型和多模态产品迭代,创业公司则在垂直场景和用户体验上不断突破。本文梳理年度关键进展,剖析主流产品、用户行为与未来趋势,助你洞悉AI消费化的深层逻辑。

本文基于Aman Khan在AI Engineer World Fair的现场演讲,深度解读AI产品经理(AIPM)在推动AI应用落地时面临的挑战、独特方法论和真实案例。你将看到从自驾车到生成式AI的评测演变,以及如何用“评测”取代传统需求文档,打造更可靠的AI产品。

2025年被寄予厚望的AI Agent,并没有如预期那样全面爆发,而是走向了一条更务实的道路。这期《The AI Daily Brief》揭示了一个关键转折:OpenAI开始实验性支持Anthropic提出的Skills机制,这可能比任何单一代理产品,都更重要。

这期《AI Daily Brief》把视角从“刷榜”的模型基准,拉回到真实世界的工作任务,同时又突然切入中美芯片博弈与资本市场震荡。它展示了评测方法、算力成本、地缘政治如何在同一时间点交织,塑造AI行业的真实走向。

这场演讲并不是一次常规的模型发布,而是一份关于“如何把小模型做成好用Agent”的方法论说明。Olive Song从开发者体验出发,解释了Miniax M2为何以10B参数,却在真实编码与Agent任务中赢得社区认可。

斯坦福对12万名开发者、46对团队的长期研究发现:AI并非“用得越多越好”。真正拉开差距的,是代码库卫生、使用方式,以及是否用正确的指标衡量AI带来的工程产出。

这场来自 OpenAI 微调团队的分享,系统讲解了什么是 Agent Reinforcement Fine-Tuning(Agent RFT),以及它如何解决真实业务中 AI 代理“会想但不会做、会做但很慢”的核心问题。通过多个一线客户案例,演讲者展示了 Agent RFT 在工具调用、延迟控制和少样本学习上的独特价值。

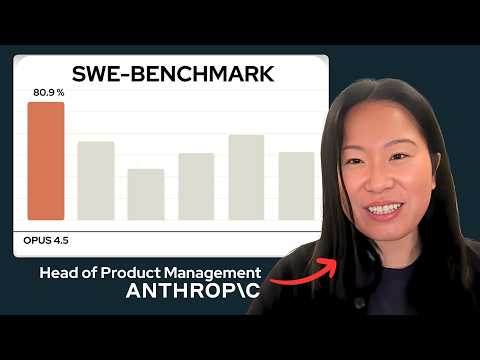

Anthropic 首位产品经理 Diane 在访谈中系统讲述了 Opus 4.5 背后的产品与研究逻辑:模型能力如何规划、脚手架为何正在变成“智能放大器”,以及为什么安全不是成本而是竞争壁垒。这篇文章提炼了视频中最具启发性的判断与真实案例。

三天前,开发者还在吹 Gemini 3 Pro;三天后,很多人已经悄悄换成了 Claude Opus 4.5。不是跑分噱头,而是真实项目、真实代码、真实 PR 的碾压级体验。这篇文章告诉你:为什么 Opus 4.5 会成为很多人眼里的“唯一主力模型”,以及它真正该怎么用。

这期《The AI Daily Brief》详细拆解了Claude Opus 4.5的真实能力边界:它不仅在多项Agent基准上刷新纪录,更重要的是把“能持续工作的AI代理”从几分钟拉长到半小时,为Vibe Coding和未来工作方式提供了现实范本。