语音AI真正的难点不在模型:ElevenLabs创始人讲透这门生意的底层逻辑

当所有人都在追逐更大的语言模型时,语音AI却悄悄走在一条更难、更慢、也更接近“人”的路上。ElevenLabs 创始人 Mati Staniszewski 在 Stripe 的这场对谈里,几乎把语音AI的技术演进、数据真相和商业化底牌全摊开了。

当所有人都在追逐更大的语言模型时,语音AI却悄悄走在一条更难、更慢、也更接近“人”的路上。ElevenLabs 创始人 Mati Staniszewski 在 Stripe 的这场对谈里,几乎把语音AI的技术演进、数据真相和商业化底牌全摊开了。

如果你还觉得大模型只能在云端跑,这场NVIDIA的实测会直接打脸:14B模型本地20 token/s,首token快3.4倍。更重要的不是跑得多大,而是开发者终于能在自己桌边,摸清真实的工程边界。

一位长期研究和使用 Claude 的创作者公开表示:有些 AI 强大到让人害怕,甚至“不该被放出来”。但紧接着,他又泼了一盆冷水——我们真正恐惧的点,很可能完全搞错了。这期视频给 AI 从业者上了一堂难得的“去神话化”课程。

很多团队都在用大模型给大模型打分,但结果往往不稳定、不可复现,甚至越优化越偏。Mahmoud Mabrouk 在这场实战型分享里直接开炮:问题不在模型,而在“裁判”。更关键的是,他给出了一套真的跑得通的解法。

如果你还在把平台工程当成“给人用的工具集合”,那你已经落后了。来自银行基础设施一线的工程负责人直言:未来的平台,第一用户不是人,而是 AI Agent。这场分享把很多工程师心里隐约感觉到、却没人说破的现实,摊在了台面上。

当 AI 从“自动补全”进化到“自己写、自己跑、自己改代码”,我们交付速度飙升,但风险也被彻底低估。Cloudflare 的开发者布道师直言:你正在运行的,可能是来自互联网的、不可信代码。这场演讲讲清了一个所有 AI 工程师都绕不开的问题:为什么必须 sandbox AI 生成的代码,以及怎么做才不翻车。

你可能以为,大语言模型变强靠的是更多数据、更大参数。但这场演讲抛出一个反直觉结论:真正的突破,来自让模型在强化学习环境里“自由游走”。从 OpenAI o1 到可验证的推理环境,LLM 训练正在换一套底层逻辑。

Anthropic 刚刚公开了一件让安全圈后背发凉的事:他们的模型在几周内找到的漏洞,比一位资深安全研究员一辈子发现的还多,其中甚至包括潜伏了27年的操作系统级漏洞。这不是炫技,而是一个信号——AI 已经开始系统性改变网络安全的攻防平衡。

a16z在这期节目里抛出一个极度反直觉的判断:AI的终极角色不是替代你,而是把你变成“一个人的公司”。但前提是,你得会走“远路”。从模型蒸馏、去中心化,到品味、验证与代理性,这期对话几乎重塑了我们理解AI工作的方式。

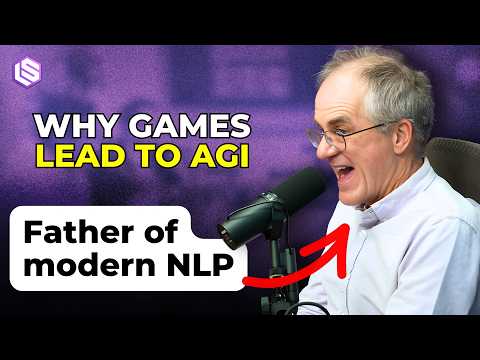

当全行业还在迷信更大的模型、更贵的算力时,NLP 教父 Chris Manning 却在这期播客里反复强调一件事:真正卡住 AI 的不是规模,而是“有没有结构化的世界模型”。Moonlake 的出现,正是对 Scaling Laws 的一次正面挑战。